情報処理推進機構(IPA)は7月5日、「AI利用時の脅威、リスク調査報告書」についてIPAテクニカルウォッチで公開した。新しい技術としてAIが業務利用されつつある状況で、セキュリティリスクの認識や安全な利用のための組織内の規程や体制の実態を調査している。

同調査は2024年3月18日~21日、ウェブアンケートにより実施したもの。事前調査は企業・組織に従事する4,941名を対象とし、本調査はそのうちAIを業務で利用している組織の1,000名を対象としている。事前調査の属性は、職業では会社員が84.4%を占め、役職では一般社員が54.5%を占めた。年代や企業規模は比較的均一となっている。

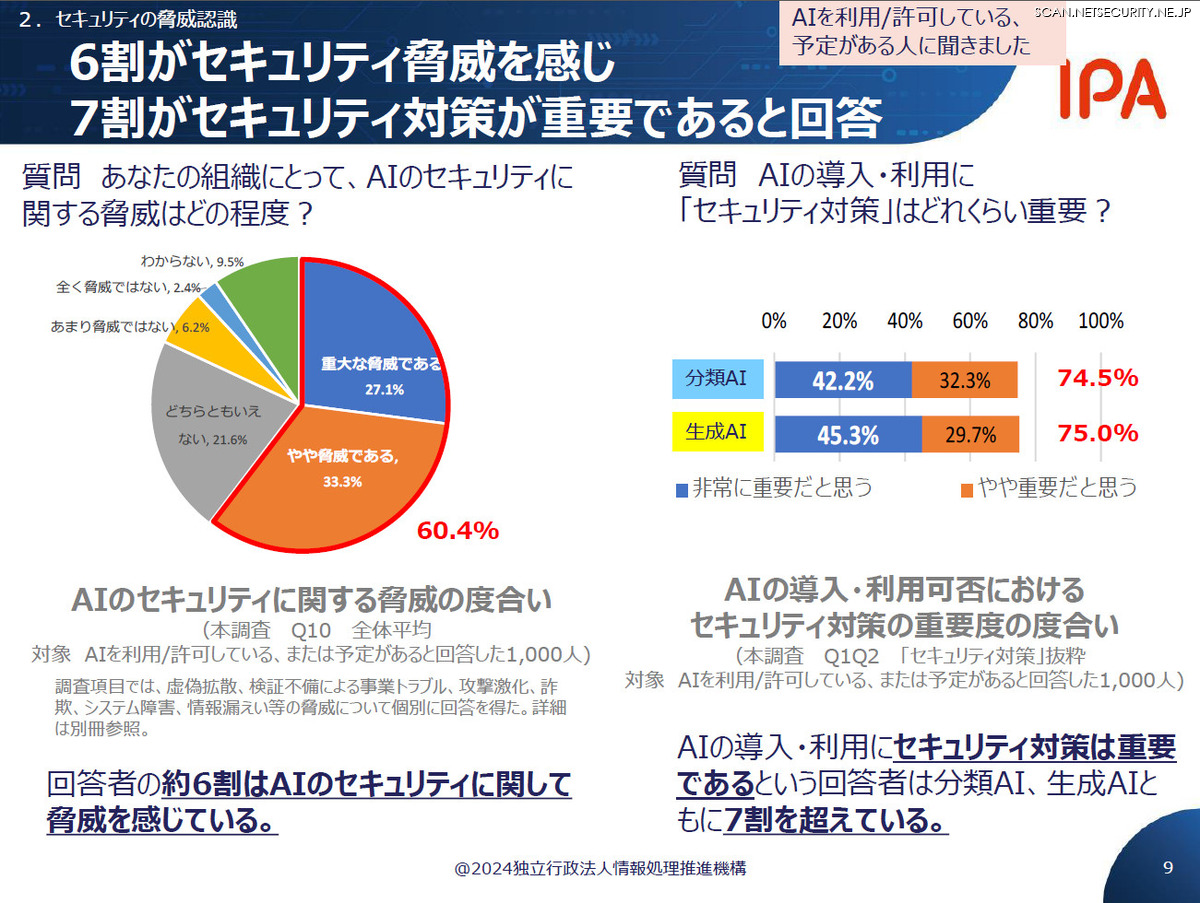

なお、設問ではAIをChatGPTなどの「生成AI」と、従来型の「分類AI」に分けている。また、単に「AI」というときは双方を合わせたものとなっている。

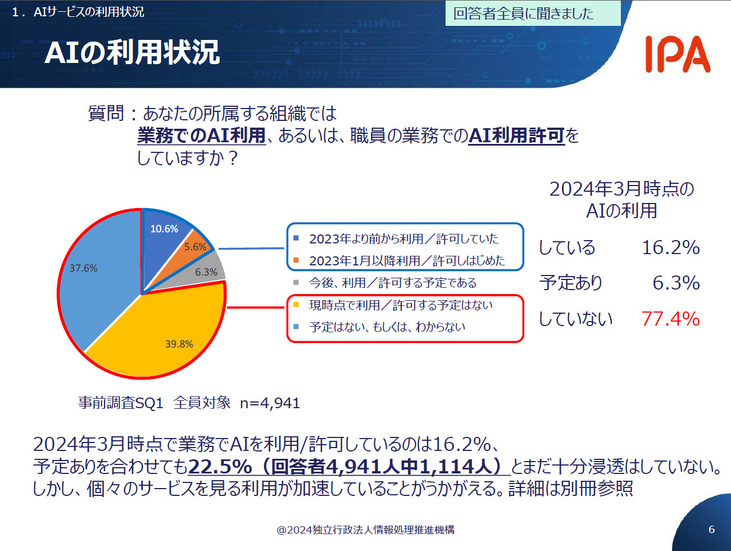

事前調査において業務でのAI利用を聞いたところ、「2023年より前から利用・許可していた」のは10.6%、「2023年1月以降利用・許可しはじめた」は5.6%と、利用しているのは16.2%、「今後、利用・許可する予定」(6.3%)を合わせると22.5%であり、十分に浸透していない状況としている。

AIで利用している業務を聞いた結果では、業種共通で利用できるサービスから利用が進んでいる。その中でもチャットや質問回答といった顧客向けサービス改善の利用が先行しており、翻訳や文章作成といった社内業務の効率化がこれに続いた。業種でみると、チャット・質問回答サービスは通信業、サービス業での利用が多く、翻訳サービスは業種による差はみられなかった。

AIを利用・許可している、あるいはその予定のある人にAIのセキュリティに関する脅威について聞いたところ、「重大な脅威」と回答したのは27.1%、「やや脅威である」は33.3%と、約6割がAIのセキュリティに関して脅威を感じていた。また、AIの導入・利用にセキュリティ対策は重要であるという回答者は分類AI、生成AIともに7割を超えていた。

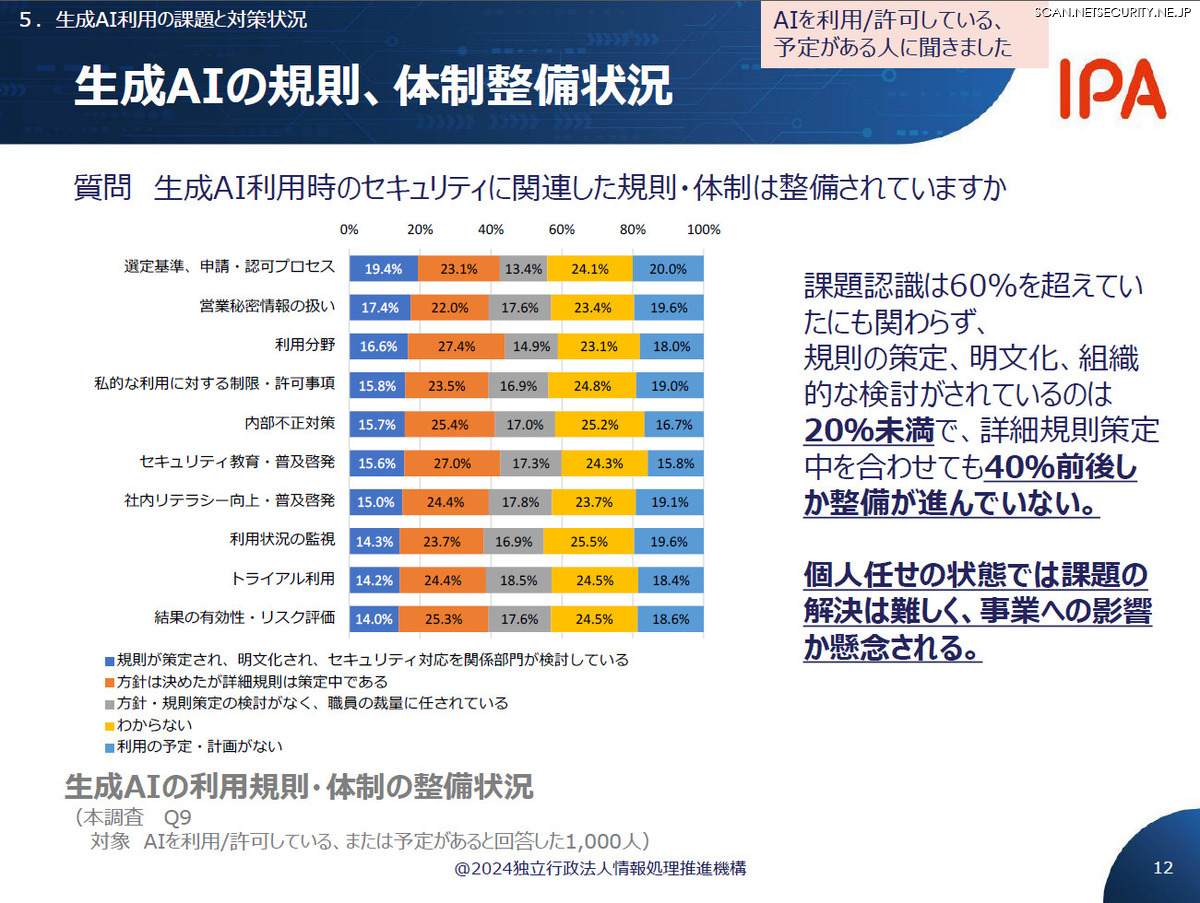

課題認識が6割を超える一方で、生成AI利用時のセキュリティに関連した規制の策定、明文化、組織的な検討がなされているのは20%未満であり、詳細規則の策定中を合わせても40%にとどまった。個人任せの状態では課題の解決は難しく、事業への影響か懸念されるとしている。

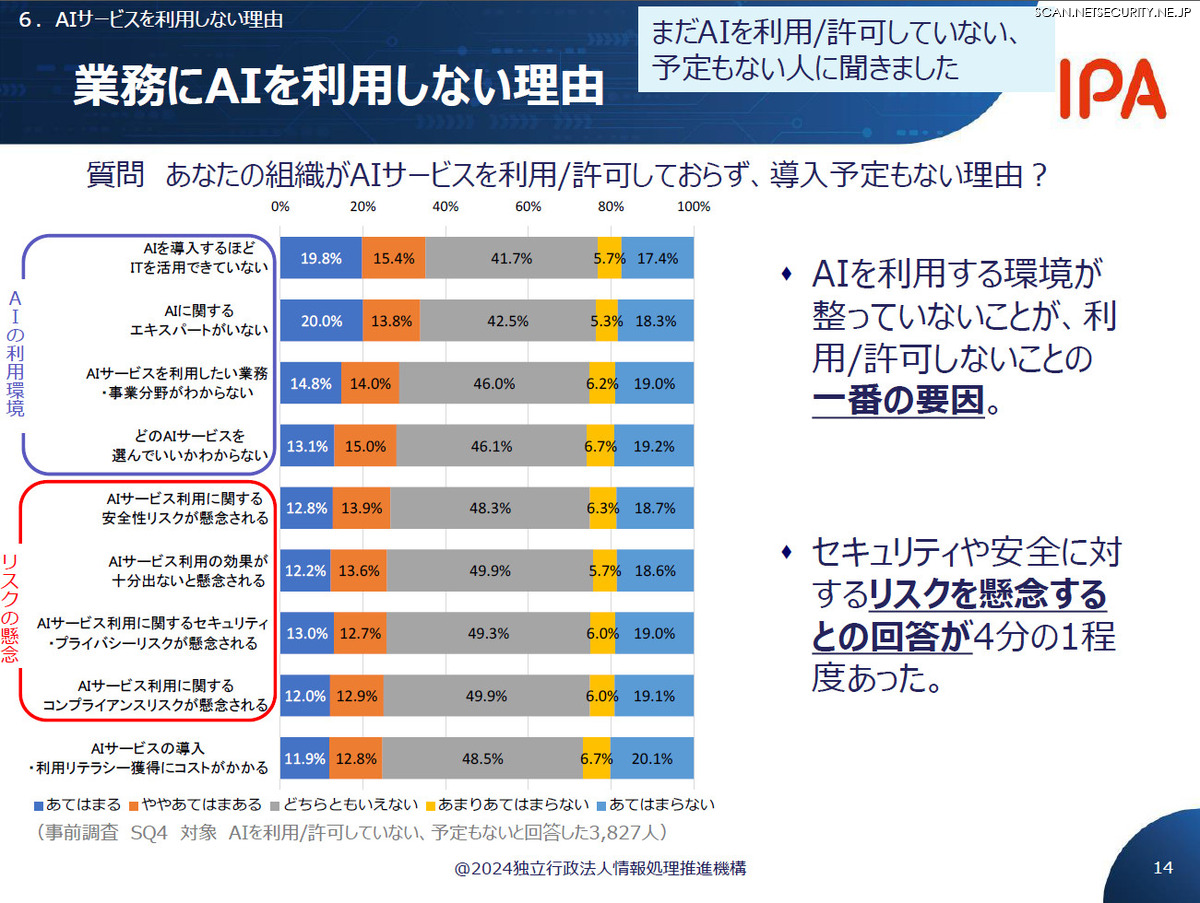

業務にAIサービスを利用/許可しておらず、導入予定もない理由では、「AIを導入するほどITを活用できていない」(19.8%)、「AIに関するエキスパートがいない」(20.0%)など利用環境の問題が上位となり、「安全リスクへの懸念」(12.8%)や「効果が十分に出ない懸念」(12.2%)などセキュリティ屋安全に対するリスクへの懸念が相対的に低い結果となった。