Okta Japan株式会社は4月1日、AIエージェントを「人と同等に」管理するための具体的な手法についての解説記事を発表した。同社のシニア ソリューションエンジニアの南野要氏が執筆している。

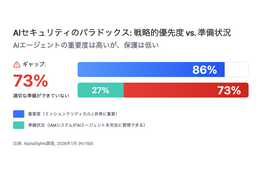

Oktaでは、AIエージェントの時代でセキュリティリスクとして起こり得るのは、許可されていないアクセスや、過剰に付与された権限、コンプライアンスと監査のギャップ、不十分な権限管理、シークレットや資格情報の漏えい、データプライバシーリスクなど、いずれも「誰がどこまでできるのか」という権限・制御・データ管理の問題に帰結するため、AIセキュリティの確保はアイデンティティセキュリティと切り離せないと考えているという。

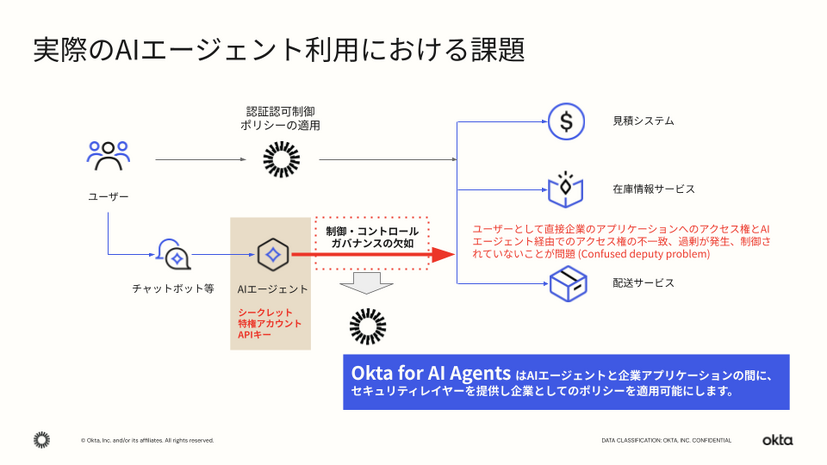

同記事では、「今ある在庫から最短で発送可能なものをリストして、見積もりを作ってください」とチャットで依頼すると、企業内のAIエージェントが見積もりシステムや在庫情報、配送サービスに能動的にアクセスするが、このAIエージェントが各サービスに対して「何をどこまでできるのか」という制御は、現状ほとんど行われておらず、さらに深刻な点として、シークレットや特権アカウント、APIキーといった強力な権限を持つ認証情報をAIエージェントに保持させているケースが非常に多いことを挙げている。

ユーザーが直接業務を行う際には、認証基盤プラットフォームによる認証と認可の制御がしっかり適用され、適切なポリシーが適用される一方で、AIエージェントを経由するとユーザーの権限以上のことができてしまうという「権限の不一致」が生じており、同問題は「Confused Deputy Problem」とも呼ばれ、権限の不一致に起因する事故も急増している。

Oktaでは同問題に対応する新サービスとして、AIエージェントと企業のアプリケーションの間にセキュリティレイヤーを設け、一貫した企業ポリシーを適用する「Okta for AI Agents」を紹介している。Oktaのプラットフォームは「Identity security fabric」というアプローチに基づき、従業員や顧客、パートナーといった人間のアイデンティティ管理に加え、サービスを管理するためのアカウントや自動化ツールのアカウントといった「非人間アイデンティティ(NHI)」も保護対象としてきたが、今回はその対象に「AIエージェント」も含め機能を拡張している。

AIエージェントのライフサイクル管理における4つの段階は下記の通りで、これらは人間に対して適用してきたセキュリティ管理の考え方をそのまま拡張したもので、「人間と同等に扱う」という原則が一貫して貫かれている。

・可視化:企業内に存在するAIエージェントをすべて把握。

・登録:把握したAIエージェントを企業のアイデンティティとして登録。

・制御・保護:登録されたAIエージェントに対して、企業のポリシーを適用。

・統制:継続的に監査を行いながら、権限を管理し続ける。

「Okta for AI Agents」では、この4段階を実現するために下記の機能群を提供している。

・「可視化」を担う「Shadow AI agent discovery」

・「登録」を担う「Universal Directory」

・「制御・保護」を担う「API Access Management / Privileged Credential Management」

・「統制」を担う「Governance for Agents as a Resource」