アプリケーションやインフラ全体における AI の急速な統合は、従来のセキュリティ監視の限界を超えています。 自律型エージェントやクラウドベースの AI が企業の中心になるにつれ、セキュリティチームは従来のツールでは設計上確認できない新たな種類のリスクの管理に苦慮しており、AI のエクスポージャー管理に重大なギャップが生じています。

こうしたギャップを解消し、AI セキュリティリスクを軽減するために必要な機能をセキュリティチームに提供するために、Tenable は本日、Tenable One AI Exposure を発売しました。Tenable One サイバーエクスポージャー管理プラットフォームで一般提供が開始されたこれらの機能により、組織はイノベーションを減速させることなく、AI を活用したワークフローを保護できます。

●エクスポージャー管理のギャップについて

AI エクスポージャー管理のギャップとは、セキュリティチームが直面する 3 つの課題に対する可視性を指します。「従業員がどのように AI を使用しているか」「AI がどこで稼働しているか」そして「組織内外の相互接続されたシステム全体で AI エクスポージャーがどのように蓄積されているか」です。

AI エクスポージャーは、さまざまな理由から測定が困難です。 理由の 1 つは、それが従来のサイバーリスクとは同じ姿をしていないという点です。 AI エクスポージャーは 1 つのシステムの中に潜むわけではなく、 脆弱性として顕在化することもありません。 また、攻撃者による悪用を待たずして被害をもたらします。 AI のセキュリティリスクは、以下のような場所に現れます。

・ChatGPT、Copilot、組み込みの SaaS 機能などの従業員向け AI プラットフォーム

・クラウドベースの AI サービスと AI モデルのパイプライン

・API、エージェント、ブラウザのプラグイン

・公開されているアプリケーションとサービス

こうした導入の多くは、従来のセキュリティワークフロー以外で実施されています。 シャドー AI のデプロイメント、忘れられたテスト環境、安全でない統合、過剰に権限付与されたサービスなどは、多くの場合セキュリティチームにその存在を気づかれないまま、静かにアタックサーフェスを拡大しています。

同時に、AI ワークロードはインフラ、アイデンティティ、API、データアクセスから成る複雑なチェーンに依存しています。 たった 1 つの設定ミスや過度に広範な権限が、日常的な AI 利用を影響の大きなエクスポージャーへとつなげてしまう可能性があります。

AI とのやり取りは、プロンプト、アップロード、応答、自動アクションを通じて絶えず行われるため、適切な可視性とガードレールが導入されていなければ、承認された使用であっても、意図せず機密データを危険にさらしてしまう可能性があります。

最後に、AI エクスポージャーが単一のアラートや脆弱な資産として現れることはほとんどありません。 むしろ、つながりを通じて顕在化します。たとえば、 次のような機能があります。

・従業員が承認済みのサードパーティーツールを使用する

・そのツールが、社内の AI サービスやエージェントを呼び出す

・そのエージェントには、機密のデータやシステムへのアクセス権がある

・設定ミスや公開エンドポイントによって、そのアクセスが到達可能になる

それぞれのコンポーネントは、単独では無害に見えるかもしれませんが、 組み合わさることで、真のリスクが生じます。

従来のセキュリティツールは、これらの要素を別々に確認する傾向がありました。たとえば、クラウド態勢はここで、アイデンティティ権限はあそこで、アプリケーションリスクはまた別の場所で、といったような様子です。こういったシグナルを結びつける方法がないと、セキュリティチームはエクスポージャーを管理する間もなく、対処療法に追われることになります。

● Tenable One AI Exposure の概要

Tenable One AI Exposure は、社内外、オンプレミス、クラウドを問わず、組織全体の AI 関連のエクスポージャーを継続的に検出、文脈化、優先順位付けすることで、こうした可視性のギャップの解消を支援します。そして、AI がどこで稼働し、何とつながり、どこでエクスポージャーを発生させているのかについての、リスク認識型の全体像を提供します。

Tenable One は、別個の検出結果を提示する AI サイバーセキュリティのポイントツールとは異なり、アクティビティチェーン全体を結び付けて一元的に可視化し、AI のアプリケーション、インフラ、アイデンティティ、エージェント、データがどのように組み合わさって実際のリスクを生み出すかを示します。 こうした関係性を関連付けることで、Tenable One は、セキュリティチームが最も重大な AI エクスポージャーを優先的に処理し、すべての環境において AI セキュリティリスクを軽減できるように支援します。

● Tenable One は AI のアタックサーフェスの保護にどのように役立つのか

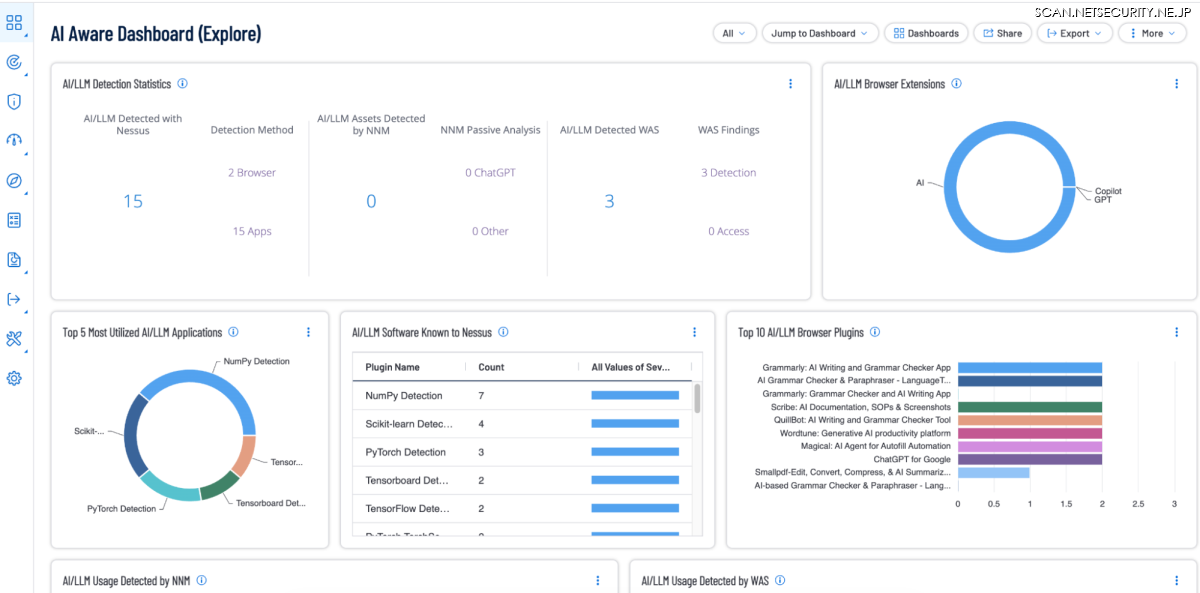

(1)組織全体での AI の検出

AI が存在する場所がわからなければ、AI リスクを管理できません。

Tenable One は、内部環境と外部アタックサーフェス全体わたって AI の利用状況を継続的に検出することで、盲点を排除し、AI フットプリントの最新状況を常に把握できるよう支援します。 これには、アプリケーション、エンドポイント、クラウドワークロード、API、エージェント、一般に公開されているサービス全体にわたる承認済み AI とシャドー AI の可視化も含まれます。

セキュリティチームは、AI サービスがどこで実行されているか、どのテクノロジーが使用されているか、外部エクスポージャーと社内での認識がどの程度一致しているかを確認できます。

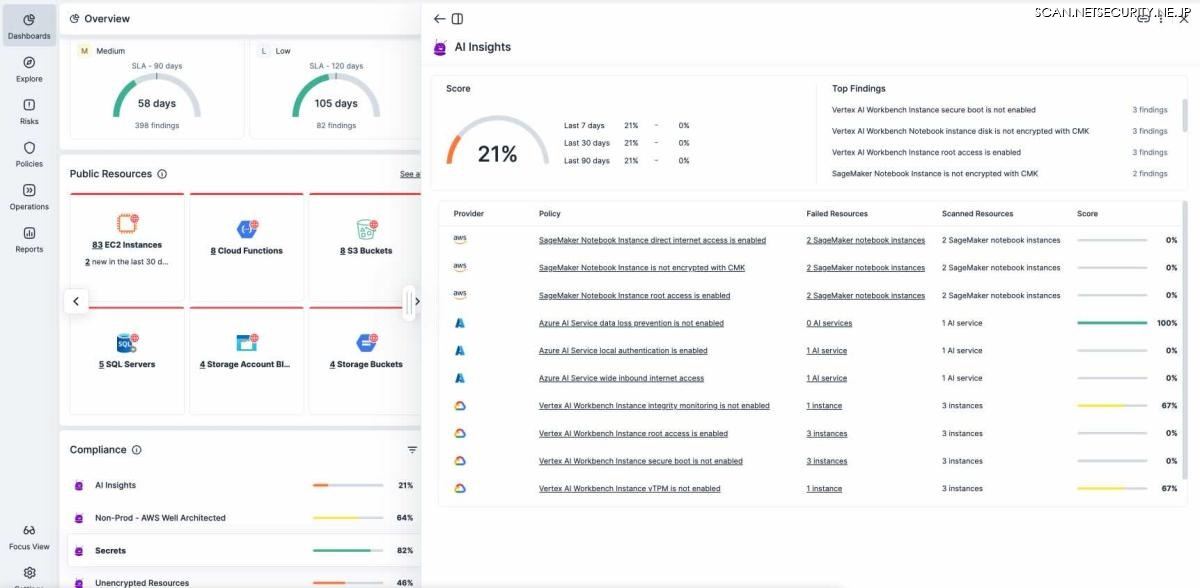

(2)AI がエクスポージャーを生み出す仕組みの理解

検出だけでは十分ではありません。 AI のリスクは、システムがどのように相互作用するかによって生じます。

Tenable One は、クラウドプラットフォームやサービス全体の AI ワークフローをマッピングし、AI モデル、インフラ、ストレージ、ネットワーク、アクセス制御がどのように連携しているのかを明らかにします。 AI 関連のソフトウェアやクラウドリソースの脆弱性や設定ミスを浮き彫りにすると同時に、そういったコンポーネントがアクセスできるデータやシステムに関する文脈情報を提供します。

AI インフラをアイデンティティやアクセスパスと結びつけることで、AI が存在する場所だけでなく、実際にエクスポージャーが生じる場所を明確に把握できるようになります。

(3)AI ワークロード、サービス、アクセス権の保護

AI リスクを低減するということは、攻撃者が悪用するギャップを解消することです。

Tenable One ならば、AI ワークロードやモデル環境におけるリスクのある設定を、悪用される前に特定し、修正することができます。 また、AI サービスやエージェントに関連する過剰な権限やアイデンティティの弱点を明らかにすることで、最小権限アクセスを適用し、重要な AI リソースを危険にさらす攻撃経路を減らすこともできます。

こうしたアイデンティティベースのエクスポージャーに関するインサイトにより、セキュリティチームは最も深刻な弱点の組み合わせへの対処に集中できるようになります。

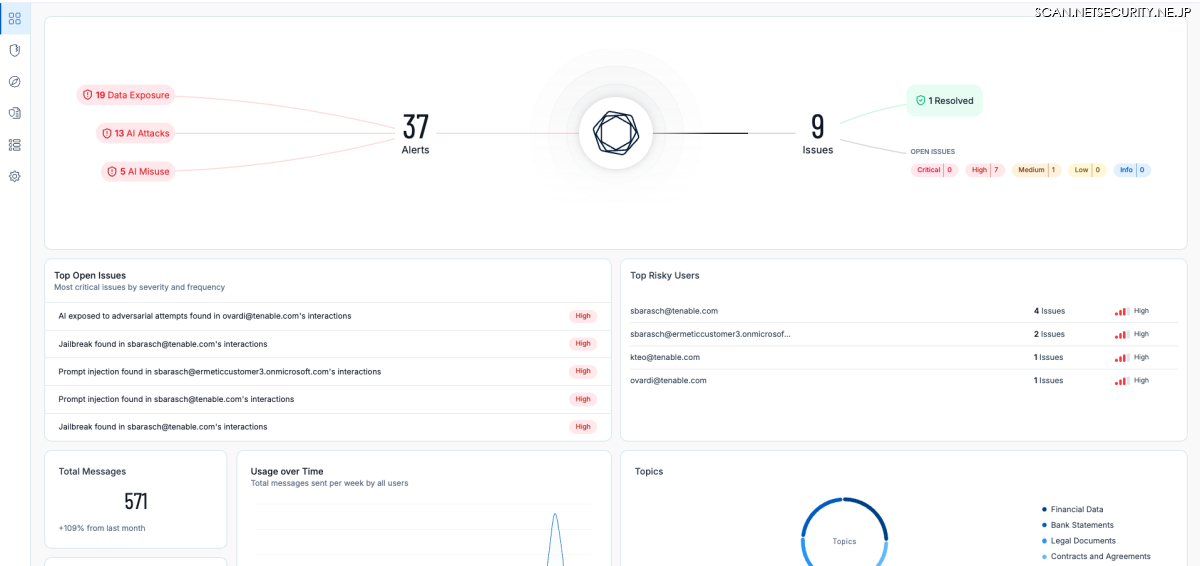

(4)AI の利用とデータフローの管理

AI を導入するからといって、セキュリティやコンプライアンスを犠牲にする必要はありません。

Tenable One は、従業員やエージェントがどのように AI プラットフォーム (ChatGPT、Copilot、組み込みの生成 AI 機能などのツール) とやり取りするのかを可視化できます。 また、そういったやり取りにおけるデータの流れも示します。 担当チームは、プロンプトやアップロードを通じて共有された機密データを特定し、AI 利用規約を適用し、ユーザーをより安全な AI 動作へと導くガードレールを適用できます。

また、このプラットフォームは AI 固有の脅威や悪用 (プロンプトインジェクションやジェイルブレイクの試みなど) も検出し、迅速かつ自信に満ちた対応を支える精度の高い文脈情報を提供します。

●イノベーションを減速させない、AI の安全な導入

AI は必ずしも最大の盲点ではなく、セキュリティは必ずしもイノベーションの足かせではありません。 Tenable One AI Exposure を利用すれば、組織は侵害が発生する前にアタックサーフェス全体にわたって AI リスクを管理する事前対策型アプローチを備えていることを認識し、自信を持って次の一歩を踏み出すことができます。